艺术家对AI侵权的反击来了——

在画作里“投毒”,AI用了就会“中毒”出故障。

投毒工具由芝加哥大学团队打造,名为Nightshade,可以对画中像素添加隐形更改。

被下毒的画一旦被非法抓取成为训练数据被AI吃掉,模型就会生成混乱。

甚至还可能会破坏DALL-E、Midjourney、Stable Diffusion……这些绘图模型的正常迭代。

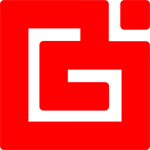

先来看一波模型中毒发作时的样子。

没中毒时模型生成的狗是左图这样婶儿的,中毒后生成的狗如右图(喵):

生成汽车更离谱,这是生成了辆牛车?

此外,研究人员用Stable Diffusion测试毒效,只需50张毒图,就能让模型输出变得奇怪;数量达到300张时,生成的图像已经完全变成了另一个物种。

△生成手提包和帽子,从左到右:没被下毒、用50张有毒图训练、100张、300张,下同

看过了实物生成,再来看生成不同艺术风格的画。

模型中毒后把奇幻艺术生成了点彩画法,立体主义生成了动漫风格:

卡通、概念艺术等也没能逃过:

重点是,由于模型训练数据量庞大,模型中毒后,AI模型开发者想清理有毒的数据样本也很难。

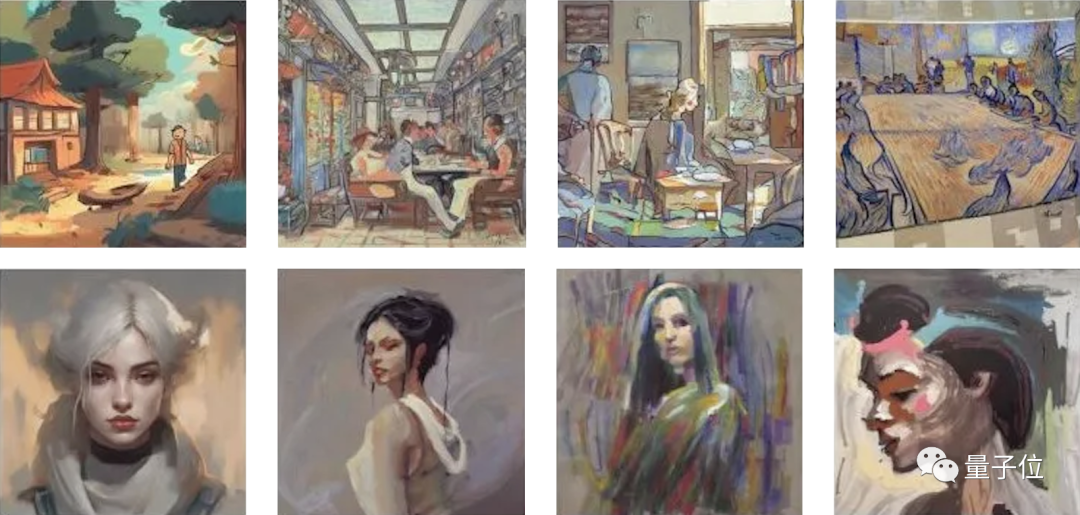

这款工具一经曝出,艺术创作者们就赶紧转发了起来,热度一路飙升。

路过的艺术创作者纷纷拍手叫绝:

终于有可以用来反击的东西了