ICLR 2024 国际学习表征会议已经来到了第十二届,将于今年 5 月 7 日 - 11 日在奥地利维也纳会展中心举行。

在机器学习社区中,ICLR 是较为「年轻」的学术顶会,它由深度学习巨头、图灵奖获得者 Yoshua Bengio 和 Yann LeCun 牵头举办,2013 年才举办了第一届。不过 ICLR 很快获得学术研究者们的广泛认可,被认为是深度学习顶会。在 Google Scholar 的学术会议 / 杂志排名中,ICLR 目前排名第十位,要高于 NeurIPS。

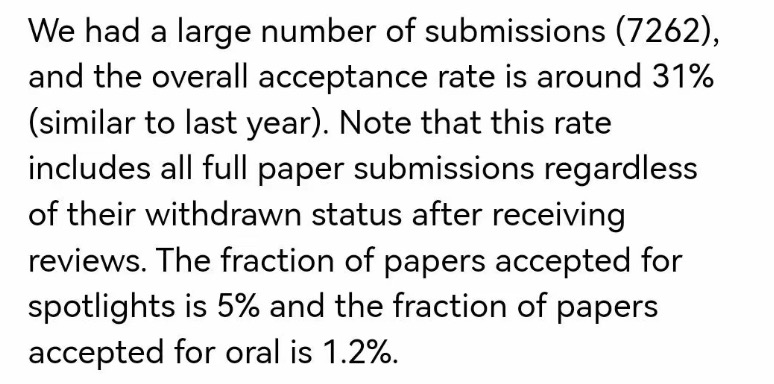

今日,ICLR 2024 将录用结果陆续通知了论文提交者。本届会议共收到了 7262 篇提交论文,整体接收率约为 31%,与去年持平(31.8%)。此外 Spotlights 论文比例为 5%,Oral 论文比例为 1.2%。

研究分析网站 Paper Copilot 对 ICLR 2024 的接收论文做了非常详细的统计,并提供了与往年直观的比较。

网站地址:https://papercopilot.com/statistics/iclr-statistics/iclr-2024-statistics/

结果出来后,依然是几家欢喜几家愁,论文被接收的学者纷纷「晒出」自己的喜悦。

机器之心报道过的苹果文生图大模型收到了被接收的喜讯。在这篇论文中,研究者提出了俄罗斯套娃式扩散模型(Matryoshka Diffusion Models,MDM),用于端到端高分辨率图像生成。

推特 @thoma_gu

知名 AI 学者、Meta AI 研究科学家田渊栋团队有 4 篇论文被接收,其中包括了一篇 Spotlight 论文。

推特 @tydsh

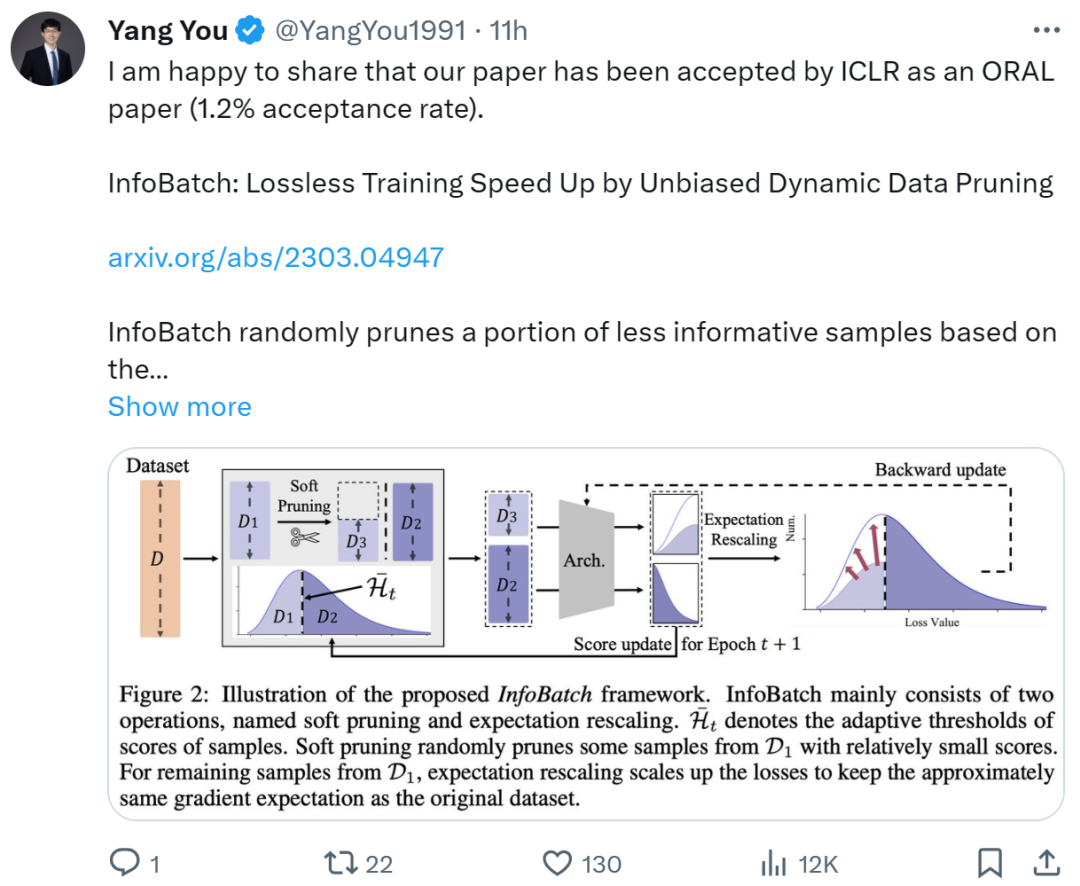

新加坡国立大学校长青年教授尤洋团队的论文《InfoBatch: Lossless Training Speed Up by Unbiased Dynamic Data Pruning》被接收为了 Oral。

推特 @YangYou1991

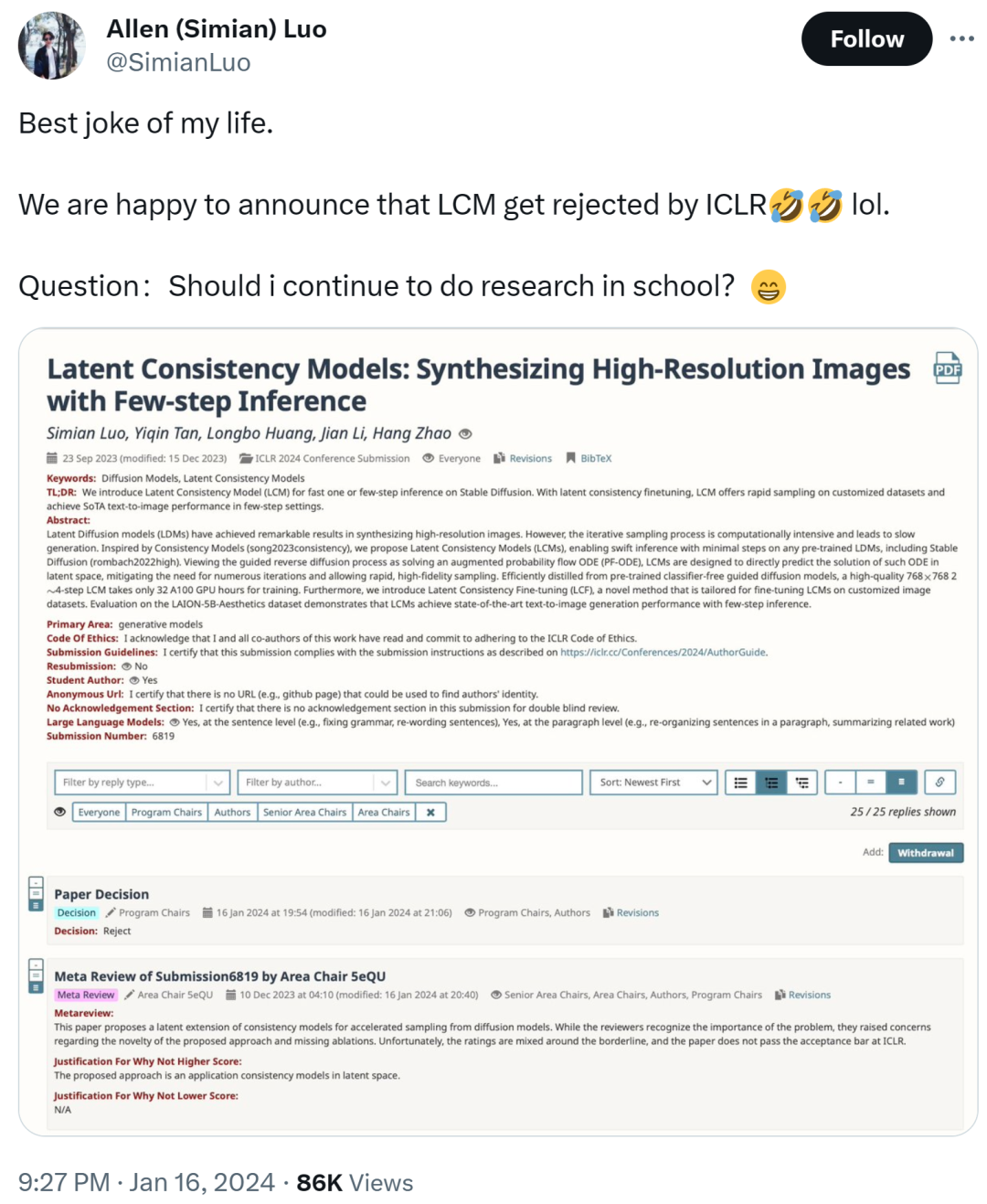

不过,有些论文似乎成了 ICLR 2024 的遗珠,比如清华大学交叉信息研究院的研究者推出的 LCM(Latent Consistency Models),它将主流文生图模型的效率提高了 5 到 10 倍,甚至做到了实时连续生图。该模型发布仅仅一个月后便浏览超百万,在 Hugging Face 平台的模型下载量超 20 万。

论文共同一作 Simian Luo 感叹这是「这辈子最好笑的笑话」。

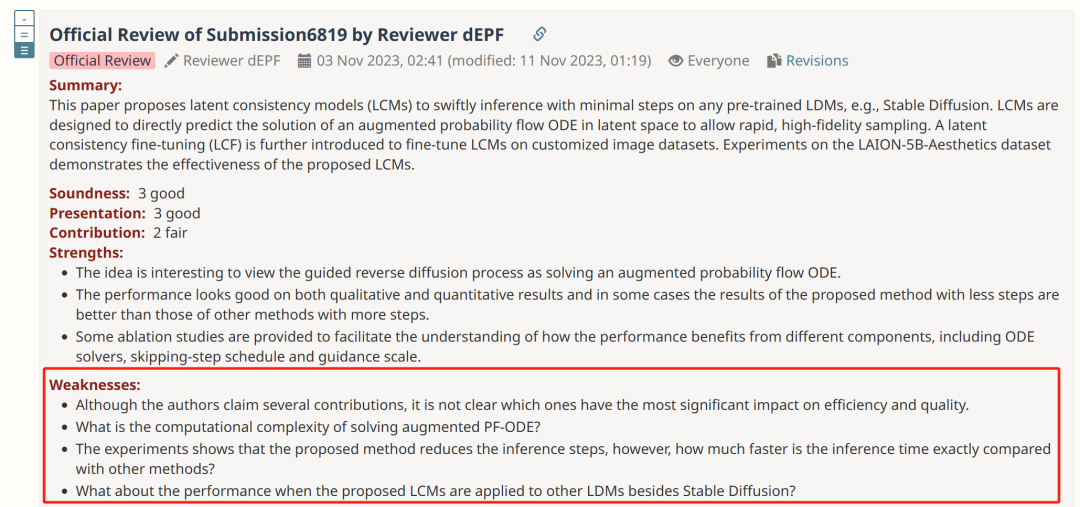

我们找到了一位审稿人的意见,他指出论文的缺点有这些:没说清楚哪些贡献对效率和质量影响最大、没给出求解增强 PF-ODE 的计算复杂度、没说明与其他方法相比推理时间到底快了多少、 没给到 LCM 除用于 Stable Diffusion 以外其他 LDMs 的性能如何?